AMD Luncurkan Instinct MI350P PCIe: Performa AI “Drop-in” Tanpa Rombak Data Center

Bagi banyak organisasi, mengadopsi AI sering kali berarti pilihan sulit: biaya cloud yang tidak terprediksi atau investasi gila-gilaan untuk mendesain ulang sistem daya dan pendinginan di data center guna mendukung platform akselerator GPU khusus.

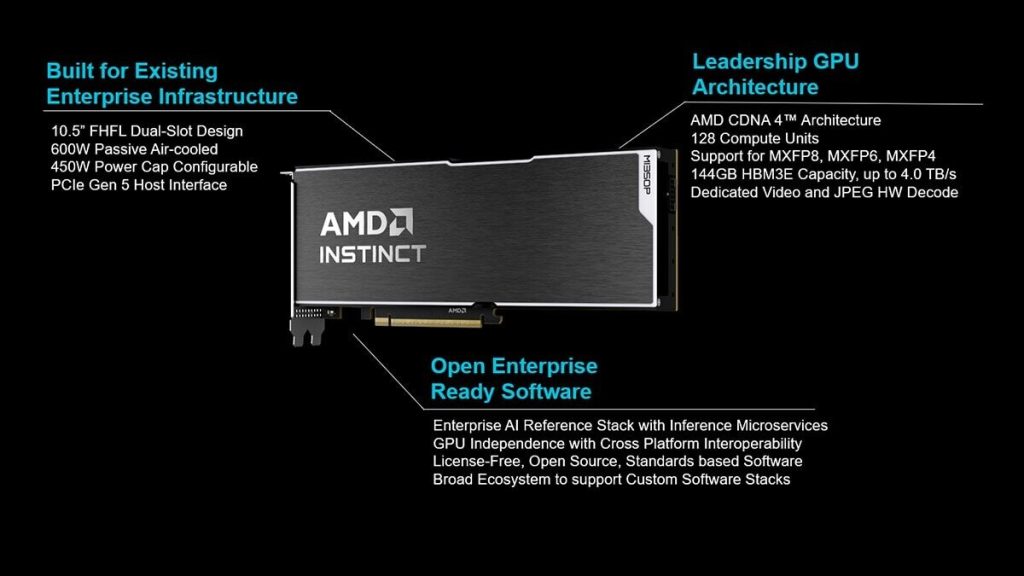

AMD kini memberikan “jalan tengah” melalui AMD Instinct MI350P PCIe. Ini adalah kartu grafis dual-slot yang dirancang untuk langsung dipasang (drop-in) pada server standar berpendingin udara (air-cooled) yang sudah Anda miliki saat ini.

Performa Tinggi dalam Form Factor Standar

AMD Instinct MI350P PCIe bukan sekadar kartu grafis biasa; ini adalah mesin inferensi AI yang sangat kuat. Dirancang untuk era agentic AI, kartu ini ideal untuk menjalankan model AI skala kecil hingga besar serta saluran pipa RAG (Retrieval-Augmented Generation).

Spesifikasi Kunci MI350P PCIe:

- Memori: 144 GB HBM3E (High Bandwidth Memory).

- Bandwidth Memori: Mencapai 4 TB/s, memungkinkan pemrosesan data masif dengan latensi rendah.

- Throughput (MXFP4): Estimasi 2.299 TFLOPS dengan puncaknya mencapai 4.600 TFLOPS. Ini diklaim sebagai performa tertinggi yang tersedia saat ini dalam form factor kartu PCIe enterprise.

- Dukungan Presisi: Mendukung spektrum luas mulai dari FP8, MXFP8, hingga presisi rendah MXFP6 dan MXFP4 untuk efisiensi maksimal tanpa mengorbankan fungsionalitas.

Ekosistem Terbuka dan Skalabilitas ROI

AMD memahami bahwa hardware hebat tidak ada artinya tanpa software yang mendukung. Oleh karena itu, Instinct MI350P dibangun di atas standar terbuka:

- Integrasi Mulus: Mendukung penuh framework populer seperti PyTorch, Kubernetes GPU Operator, serta AMD Inference Microservices.

- Migrasi Tanpa Kode: Memungkinkan organisasi memindahkan beban kerja inferensi dari sistem lama atau cloud dengan perubahan kode minimal.

- Bebas Biaya Lisensi: AMD menyediakan tumpukan referensi AI enterprise (open-source) kepada mitra tanpa biaya lisensi. Ini membantu menekan biaya operasional (OpEx) karena Anda tidak perlu membayar biaya “per-token” seperti pada layanan AI publik.

Mengapa Ini Penting untuk Infrastruktur On-Premise?

Dengan kartu ini, perusahaan bisa mendapatkan kekuatan komputasi AI yang lebih besar daripada yang bisa ditawarkan CPU, namun tetap bisa menggunakan rak server dan infrastruktur pendinginan yang sudah ada. Dukungan terhadap sparsity pada tingkat presisi INT8 dan BF16 juga memastikan penggunaan daya yang lebih efisien dan beban pendinginan yang lebih ringan.

Singkatnya, AMD MI350P PCIe memungkinkan Anda menjalankan lebih banyak model AI dan melayani lebih banyak pengguna tepat di mana data Anda berada saat ini—aman di data center sendiri.

Sumber: AMD Blog / Instinct MI350P Product Page