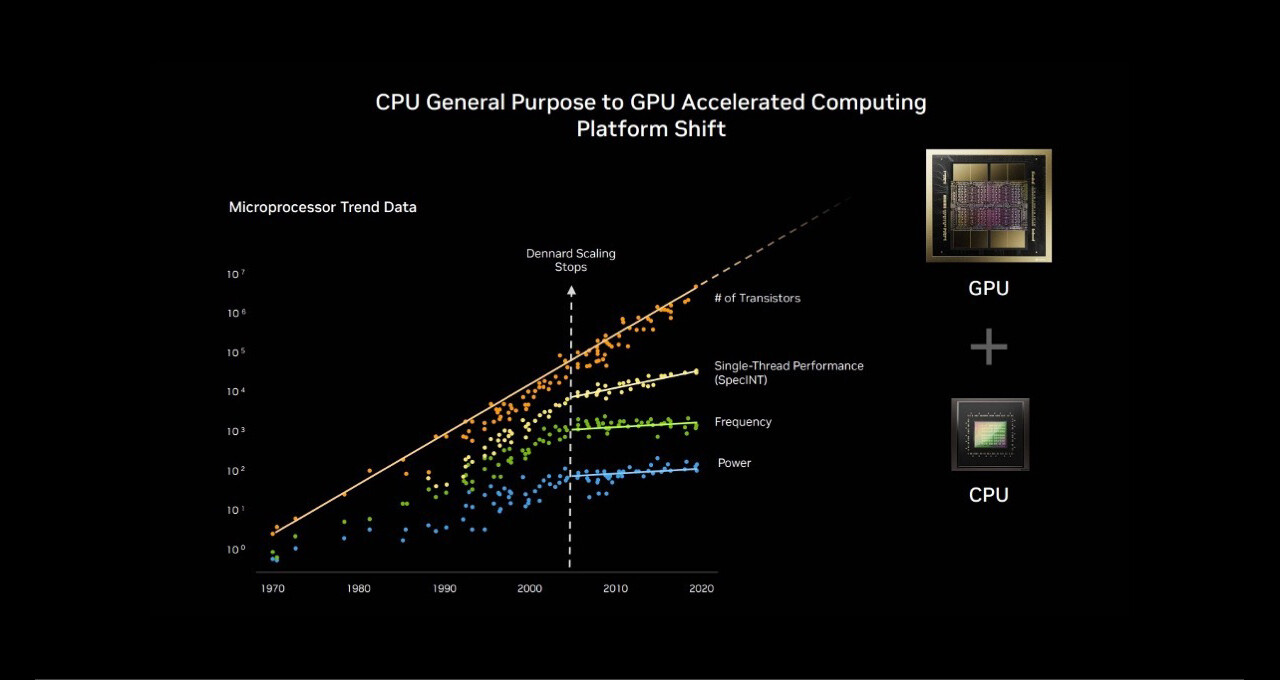

Platform komputasi akselerasi NVIDIA berbasis GPU kini menempati posisi utama dalam dunia superkomputasi, menggantikan dominasi CPU yang telah berlangsung selama puluhan tahun. Perubahan ini menandai pergeseran fundamental dalam arsitektur komputasi global, seiring berakhirnya relevansi Hukum Moore dan meningkatnya kebutuhan akan pemrosesan paralel berskala besar.

Dalam berbagai tolok ukur superkomputer yang sebelumnya dikuasai CPU, platform GPU NVIDIA kini memimpin, mendukung kemajuan di bidang kecerdasan buatan, sains, bisnis, dan efisiensi komputasi. GPU NVIDIA juga menjadi fondasi utama dalam penerapan tiga hukum penskalaan AI, yakni pre-training, post-training, dan test-time compute, yang menopang pengembangan sistem rekomendasi generasi baru, large language model, hingga AI agent otonom.

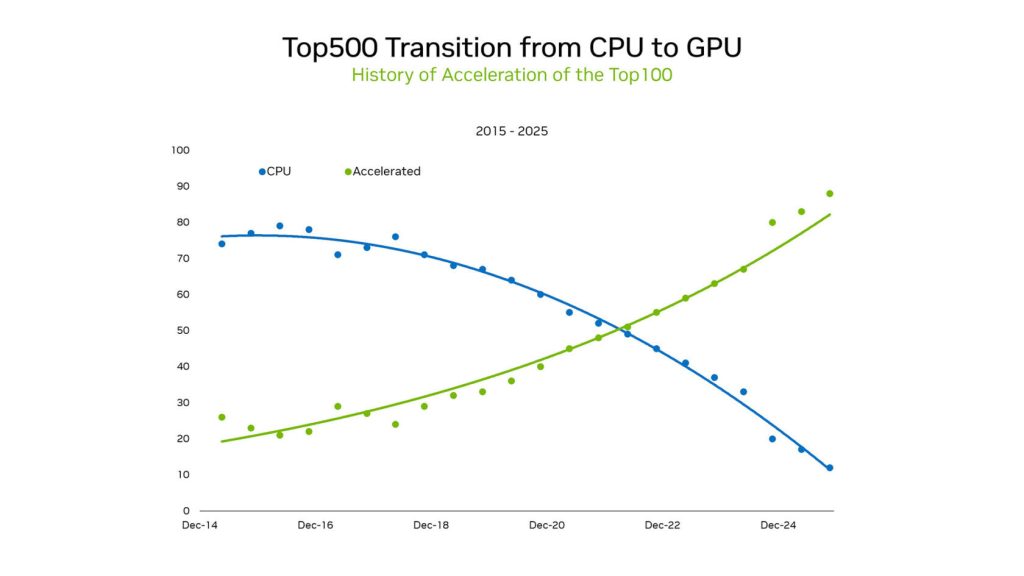

Peralihan dari CPU ke GPU menjadi sorotan utama dalam ajang SC25. Jensen Huang, pendiri sekaligus CEO NVIDIA, menegaskan bahwa lebih dari 85 persen sistem dalam daftar TOP100 superkomputer dunia kini menggunakan GPU. Angka ini mencerminkan transisi historis dari paradigma pemrosesan serial berbasis CPU menuju arsitektur akselerasi paralel masif.

Sebelum 2012, pembelajaran mesin masih bergantung pada logika terprogram dan model statistik yang berjalan efisien di CPU. Titik balik terjadi ketika AlexNet, yang dijalankan di GPU kelas gaming, membuktikan bahwa klasifikasi gambar dapat dipelajari dari data dalam skala besar. Sejak saat itu, pemrosesan paralel GPU menjadi pendorong utama gelombang baru komputasi berbasis data.

Keunggulan GPU tidak hanya terletak pada performa mentah, tetapi juga efisiensi energi. GPU mampu menghasilkan operasi komputasi jauh lebih besar per watt, menjadikan komputasi exascale lebih realistis tanpa lonjakan konsumsi daya yang tidak terkendali. Data dari Green500 menunjukkan lima superkomputer paling efisien di dunia seluruhnya menggunakan GPU NVIDIA, dengan rata-rata performa 70,1 GigaFLOPS per watt. Sebagai perbandingan, sistem berbasis CPU murni hanya mencapai sekitar 15,5 FLOPS per watt, menciptakan selisih efisiensi hingga 4,5 kali lipat dan berdampak langsung pada total biaya kepemilikan.

Keunggulan serupa juga tercermin dalam benchmark Graph500. NVIDIA mencatat rekor 410 triliun edge traversal per detik menggunakan 8.192 GPU NVIDIA H100 untuk memproses graf berskala ekstrem. Hasil ini lebih dari dua kali lipat capaian pesaing terdekat yang membutuhkan sekitar 150.000 CPU, menunjukkan penghematan signifikan dari sisi ruang, energi, dan biaya operasional.

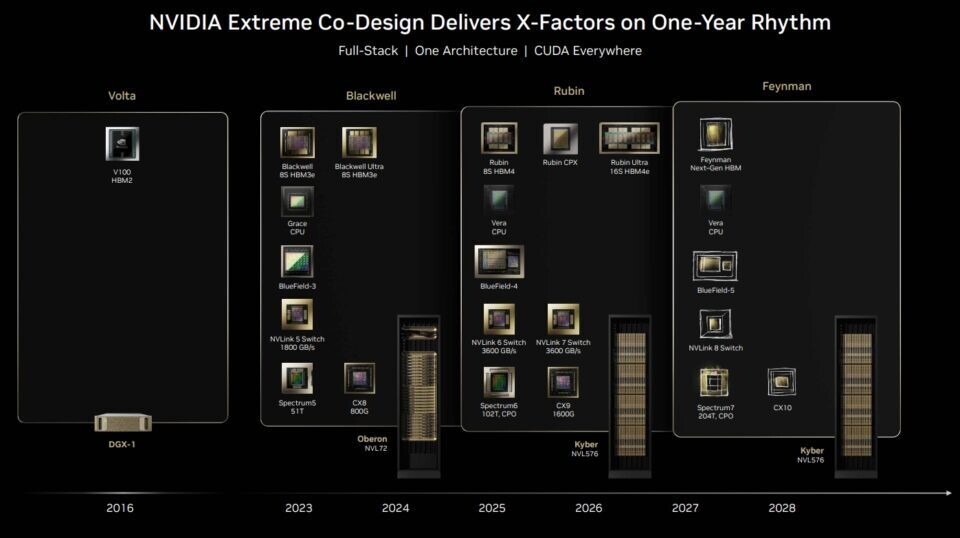

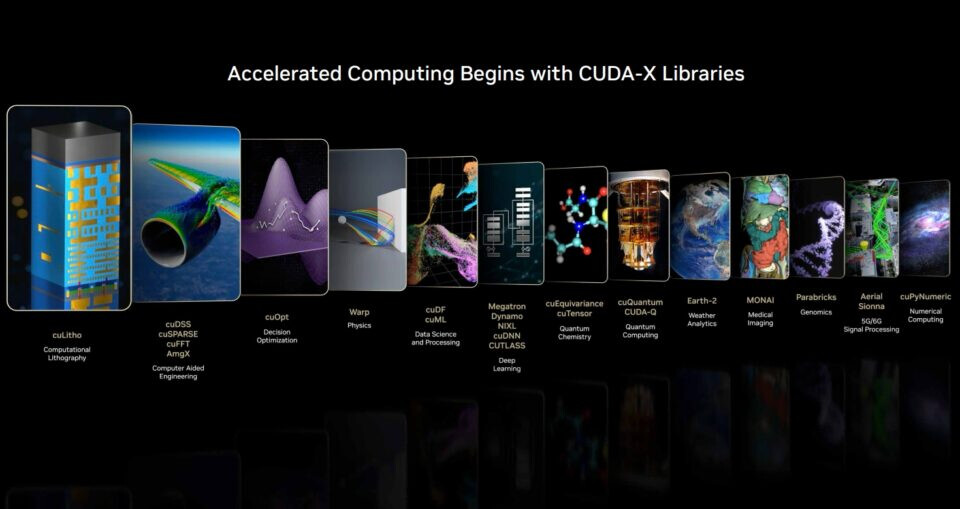

Namun, NVIDIA menegaskan bahwa platform komputasi akselerasinya bukan sekadar GPU. Seluruh ekosistem, mulai dari jaringan, memori, penyimpanan, pustaka CUDA, hingga orkestrasi sistem, dirancang secara terpadu sebagai platform full-stack. Melalui CUDA dan ekosistem CUDA-X, NVIDIA menghadirkan pustaka open-source yang mempercepat berbagai beban kerja lintas industri, mulai dari rekayasa, keuangan, analitik data, hingga biologi dan robotika.

Integrasi CUDA juga mulai diadopsi secara luas oleh platform data modern. Snowflake, misalnya, mengintegrasikan GPU NVIDIA A10 untuk mempercepat alur kerja data science. Dengan pustaka cuML dan cuDF yang terpasang secara native, pengguna dapat mempercepat pengembangan model tanpa perlu perubahan kode, dengan peningkatan performa signifikan dibandingkan CPU.

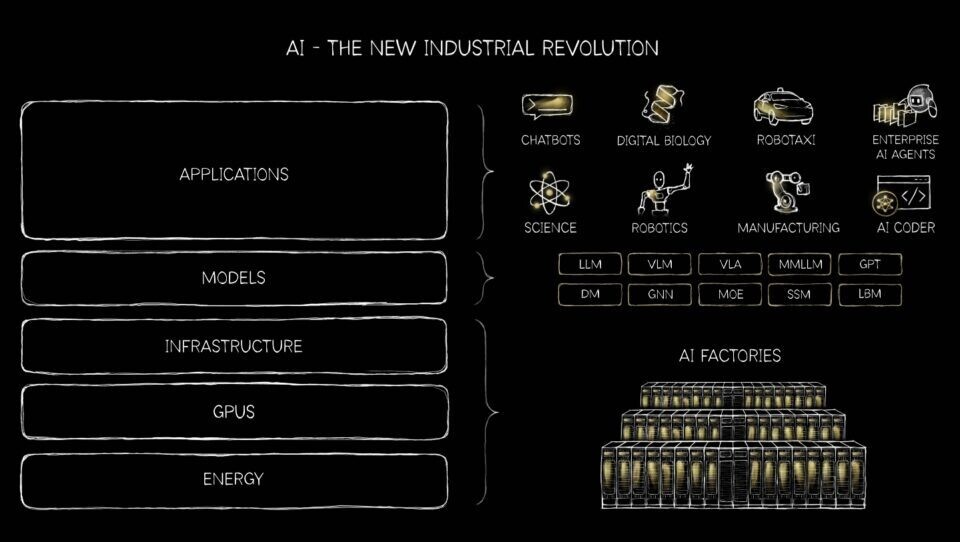

Fondasi teknis ini menjadi kunci bagi tiga hukum penskalaan AI. Pre-training scaling memungkinkan peningkatan performa model seiring bertambahnya data, parameter, dan komputasi. Post-training scaling berfokus pada penyempurnaan model melalui fine-tuning, distilasi, dan reinforcement learning, yang sering kali membutuhkan sumber daya komputasi setara dengan tahap pelatihan awal. Sementara itu, test-time scaling menjadi fase terbaru, di mana model AI melakukan penalaran dinamis secara real-time, menuntut infrastruktur inferensi yang jauh lebih besar.

Ketiga hukum ini menjelaskan mengapa GPU menjadi tulang punggung AI modern. GPU tidak hanya penting saat pelatihan, tetapi juga dalam penyempurnaan dan penerapan AI di dunia nyata. Dampaknya terlihat jelas pada sistem rekomendasi, generative AI, hingga agentic AI yang mampu merencanakan dan bertindak secara otonom.

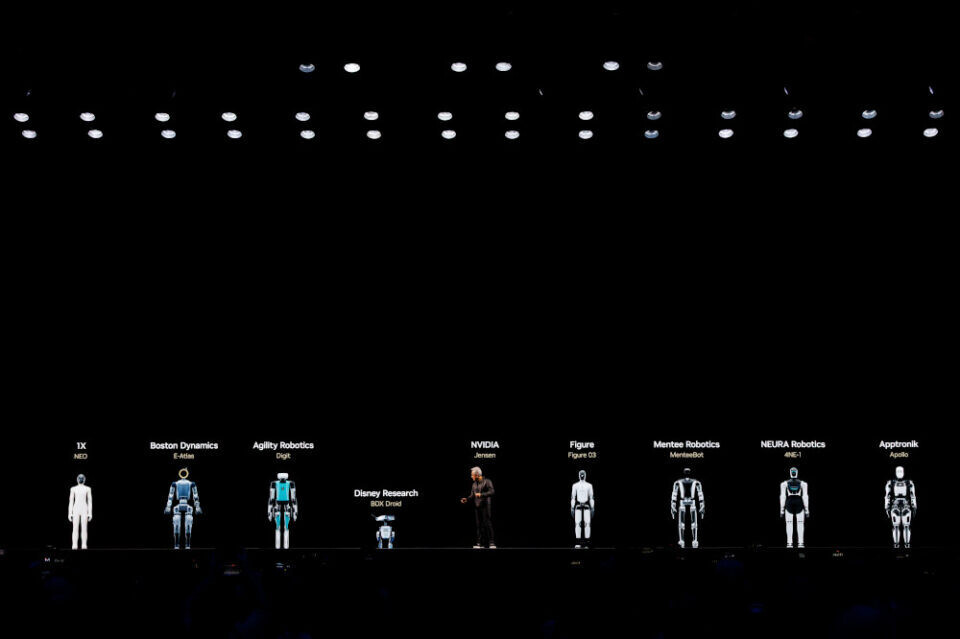

Perkembangan ini juga membuka jalan bagi physical AI, di mana kecerdasan buatan diwujudkan dalam bentuk robot. NVIDIA memproyeksikan bahwa pengembangan robot cerdas membutuhkan tiga lapisan komputasi, mulai dari pelatihan model di sistem kelas data center, simulasi di lingkungan virtual, hingga eksekusi real-time di perangkat edge. Dalam beberapa tahun ke depan, robot otonom, kolaboratif, hingga humanoid diperkirakan akan mengubah lanskap manufaktur, logistik, dan layanan kesehatan secara signifikan.

Transformasi dari CPU ke GPU menandai perubahan mendasar dalam dunia komputasi. Apa yang awalnya didorong oleh kebutuhan efisiensi energi kini berkembang menjadi platform ilmiah dan industri berskala global. Dominasi GPU NVIDIA dalam superkomputasi menjadi indikator kuat arah masa depan, di mana AI, simulasi, dan komputasi akselerasi menyatu untuk mendorong terobosan di hampir setiap disiplin ilmu.

Sumber: NVIDIA Blog