OpenAI Alihkan GPT-4o ke Model “Safety” Saat Deteksi Aktivitas Berisiko

Beberapa pengguna akhir pekan lalu memperhatikan bahwa GPT-4o terkadang mengalihkan permintaan ke model yang tidak dikenal. OpenAI kemudian mengonfirmasi bahwa mekanisme ini adalah bagian dari fitur keamanan (safety routing).

Bagaimana Mekanismenya Bekerja

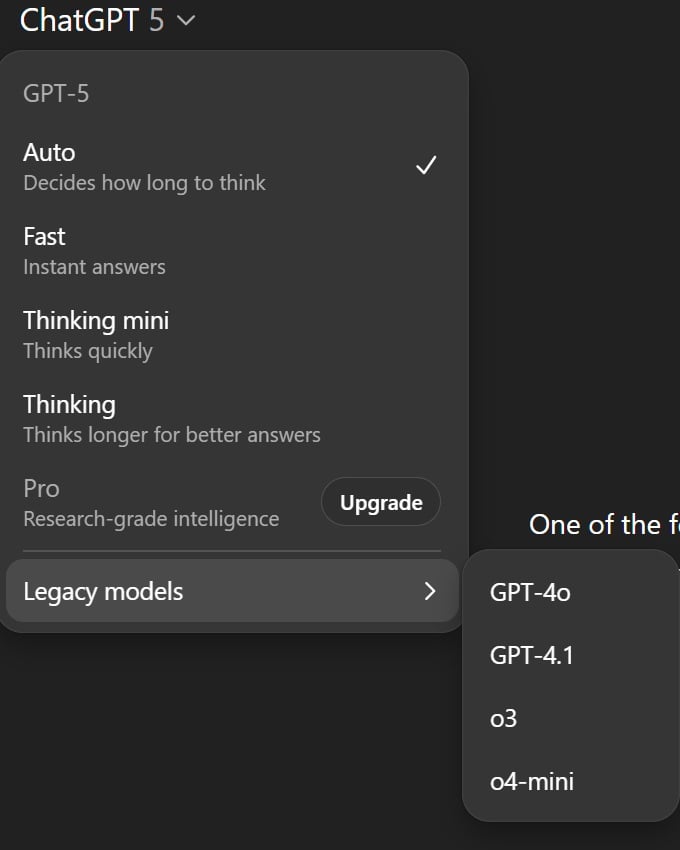

Dalam kondisi normal, ChatGPT menggunakan model sesuai pilihan pengguna. Namun, pada situasi tertentu, GPT-4o dapat beralih sementara ke model lain, misalnya gpt-5-chat-safety, untuk menangani percakapan yang dianggap sensitif atau berpotensi berbahaya.

Menurut OpenAI, pergantian model ini dilakukan per pesan dan bersifat sementara. Jika pengguna bertanya, ChatGPT akan memberi tahu model mana yang sedang aktif.

Alasan di Balik Routing

Nick Turley, VP ChatGPT, menjelaskan di X:

“Routing terjadi per pesan; peralihan dari model default hanya bersifat sementara. Ketika percakapan menyentuh topik sensitif atau emosional, sistem dapat beralih ke model reasoning atau GPT-5 yang dirancang untuk menangani konteks tersebut dengan lebih hati-hati.”

Dengan kata lain, GPT-4o akan otomatis mengaktifkan model safety jika mendeteksi pembahasan yang membutuhkan pengawasan tambahan, seperti isu emosional, kesehatan, atau potensi risiko.

Tidak Bisa Dinonaktifkan

Pengguna tidak memiliki opsi untuk menonaktifkan mekanisme ini. OpenAI menegaskan bahwa routing merupakan bagian dari sistem safeguard mereka, sebagai upaya memperkuat keamanan penggunaan AI sekaligus mempelajari pola interaksi di dunia nyata sebelum diterapkan lebih luas.

Reaksi Pengguna

Meskipun langkah ini dimaksudkan untuk keamanan, sebagian pengguna merasa keberatan karena adanya alih model tanpa persetujuan eksplisit. Namun, OpenAI menekankan bahwa tujuan utamanya adalah memastikan pengalaman lebih aman tanpa mengurangi transparansi, karena ChatGPT tetap bisa memberitahu model mana yang sedang digunakan.

Sumber: OpenAI, BleepingComputer